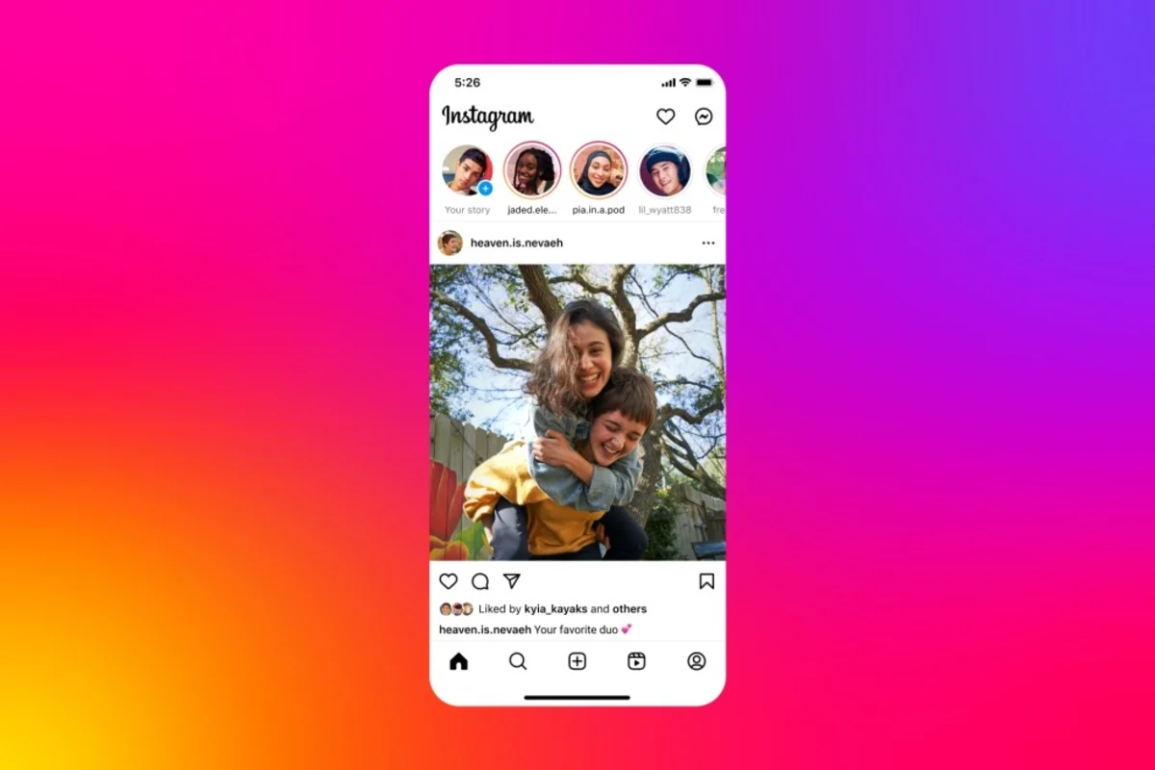

Meta refuerza el control parental en Instagram y Facebook. Ahora los menores necesitarán permiso para hacer transmisiones en vivo o desactivar filtros de contenido. También se amplía el uso de “Cuentas para adolescentes” a Facebook y Messenger.

Meta ha anunciado nuevas funciones de control parental en Instagram, enfocadas en proteger a los menores de 16 años. A partir de ahora, estos usuarios no podrán realizar transmisiones en vivo si no cuentan con la autorización de sus padres. Además, necesitarán ese mismo permiso para desactivar un filtro que difumina automáticamente imágenes con posible desnudez dentro de los mensajes directos (DMs).

Estas medidas forman parte de una expansión del sistema de “Cuentas para adolescentes” que Meta lanzó en septiembre del año pasado. Esta función coloca a todos los menores de 16 años dentro de una configuración por defecto que hace sus perfiles privados, limita las funciones de mensajería y restringe al máximo el contenido sensible que pueden ver.

Facebook y Messenger también adoptan el modelo adolescente

La compañía tecnológica confirmó que este modelo ahora también se implementará en Facebook y Facebook Messenger. Desde el lanzamiento inicial del sistema, Meta asegura que ha migrado a más de 54 millones de adolescentes en todo el mundo hacia estas configuraciones más seguras, y que la cifra seguirá aumentando con la expansión de las nuevas opciones.

“Estos son cambios significativos que han transformado por completo la experiencia de los adolescentes en Instagram”, señaló Meta en su blog oficial.

La empresa afirma que ha diseñado estas herramientas pensando en las preocupaciones más comunes de los padres, y que continuará realizando estudios y recopilando opiniones para seguir ajustando las funciones de protección infantil.

Controversias y críticas por decisiones recientes de Meta

Si bien estos nuevos controles son bien recibidos por muchos padres, Meta también ha sido objeto de críticas por decisiones recientes que apuntan en la dirección opuesta. En enero, el CEO de la compañía, Mark Zuckerberg, anunció que Instagram dejaría de trabajar con verificadores de datos externos, en favor de un sistema de “notas comunitarias generadas por los usuarios”. Según explicó, el objetivo era promover la “libertad de expresión” y eliminar lo que consideraba “sesgos políticos” de los verificadores tradicionales.

En paralelo, Meta también redujo sus esfuerzos de moderación proactiva, especialmente en temas controversiales, lo que ha encendido alarmas entre organizaciones que promueven la seguridad en línea.

Expertos en protección infantil, activistas y ONGs han advertido que esta combinación de decisiones podría traducirse en un mayor riesgo para los adolescentes, especialmente si se encuentran expuestos a contenido dañino o engañoso sin suficiente supervisión.

El propio Zuckerberg reconoció que, con estos cambios, la plataforma “atrapará menos contenido dañino”, lo que generó aún más preocupación.